Les modèles de langage visuel (VLMs) se révèlent être des pionniers dans la façon dont les machines interprètent et génèrent non seulement du texte mais aussi des images. En combinant les capacités des modèles de langage avec la vision par ordinateur, ces systèmes offrent la possibilité d’analyser des contenus multimédia d’une manière inédite. Que ce soit pour des applications commerciales, artistiques ou éducatives, les VLMs représentent une avancée majeure dans le domaine de l’intelligence artificielle. Mais que se cache-t-il derrière ce terme hyper technique ? Comment fonctionnent réellement ces modèles ? Et surtout, quel est leur potentiel et leurs limites ? Cet article vous plongera dans le cœur des VLMs, en explorant leur architecture, leurs applications réelles et en confrontant leurs promesses à la réalité sur le terrain.

Origines et architecture des VLMs

Les modèles de langage visuel (VLMs) s’appuient sur une riche histoire d’innovations en intelligence artificielle, en particulier dans les domaines du traitement du langage naturel (NLP) et de la vision par ordinateur. Ces technologies ont profité des avancées réalisées dans les réseaux de neurones profonds, qui sont devenus essentiels pour capturer des modèles et des corrélations complexes au sein de grandes quantités de données. Grâce à leur capacité à différents types de données, les VLMs ont émergé comme une convergence de ces deux champs, utilisant des représentations multimodales pour interpréter et générer des informations associées à la fois au texte et à l’image.

Les VLMs se basent généralement sur des architectures de type transformateur, qui ont révolutionné le traitement du langage en apportant des mécanismes d’attention permettant aux modèles de se concentrer sur des parties spécifiques des données d’entrée. Initialement introduit par le modèle BERT (Bidirectional Encoder Representations from Transformers), le cadre des transformers a ouvert la voie à des techniques plus avancées, notamment ceux incorporant des éléments visuels.

- Les premiers modèles de VLMs intégrant les transformateurs ont été également inspirés par des travaux d’apprentissage par transfert. Ces modèles exploitent des connaissances préalablement acquises sur des ensembles de données massifs pour optimiser la performance sur des tâches spécifiques, comme la classification d’images ou le positionnement de descriptions textuelles.

- Des architectures mises en avant comme CLIP (Contrastive Language–Image Pre-training) et DALL-E ont démontré comment les images et les textes pouvaient être jointement représentés, permettant aux modèles de générer des images basées sur des descriptions textuelles et vice versa. Ces systèmes exploitent la mise en correspondance entre des données visuelles et textuelles, renforçant ainsi leur compréhension des contextes et des significations.

L’efficacité de ces VLMs repose aussi sur des techniques d’apprentissage semi-supervisé et non supervisé, qui permettent aux systèmes d’apprendre de grandes quantités de données non étiquetées. Cela a été particulièrement utile dans le cadre de l’acquisition de connaissances à partir de collections d’images et de textes déjà disponibles sur internet, ce qui a considérablement réduit le besoin d’annotations manuelles. En facilitant ce processus, les bases de données multimodales comme COCO (Common Objects in Context) ont servi de référence pour évaluer et améliorer ces modèles.

Les implications des VLMs s’étendent également aux applications pratiques dans des domaines variés, allant de la recherche d’images et de vidéos à des systèmes de recommandation intelligents. Leurs capacités sont de plus en plus intégrées dans des technologies commerciales, apportant une dimension supplémentaire à l’interaction humain-machine. Dans cette optique, les VLMs sont devenus des compagnons indispensables dans le paysage actuel de l’intelligence artificielle, redéfinissant la façon dont nous interagissons avec les systèmes d’IA.

Ce rapprochement des disciplines et l’intégration des données multimodales rendent les VLMs particulièrement prometteurs pour le futur, positionnant cette technologie à l’avant-garde des innovations en matière d’intelligence artificielle.

Fonctionnement des modèles de langage visuel

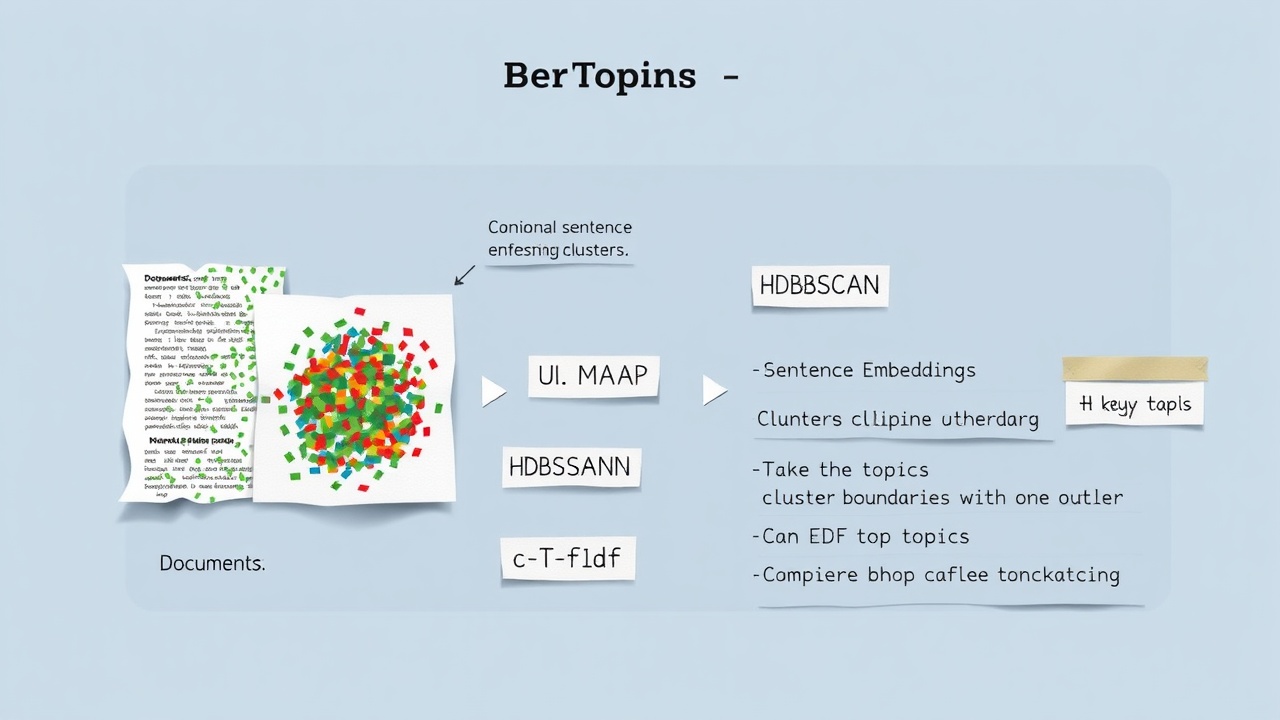

Les modèles de langage visuel (VLMs) intègrent un ensemble complexe d’algorithmes et de techniques d’intelligence artificielle pour comprendre et générer des contenus multimédia. Leur fonctionnement repose sur des architectures avancées, notamment des réseaux de neurones profonds et des mécanismes de transformation, qui permettent aux modèles d’interagir à la fois avec le texte et les images. Ce processus est orchestré par une série d’étapes clés qui permettent l’interprétation des signaux visuels et textuels.

Au cœur de ces VLMs se trouvent des réseaux convolutionnels (CNN), qui sont particulièrement efficaces pour le traitement d’images. Ces réseaux extraient des caractéristiques visuelles en analysant les pixels d’une image à différents niveaux de granularité. Ils identifient des formes, des textures, et des couleurs, formant ainsi une représentation hiérarchique de l’image. Une fois les caractéristiques visuelles extraites, un modèle de langage, souvent basé sur les transformers comme BERT ou GPT, entre en jeu. Ce modèle traite les entrées textuelles correspondantes, établissant des corrélations entre les éléments visuels et verbaux.

La fusion de ces deux modes de traitement permet au VLM de construire des représentations conjointes, où les informations visuelles et textuelles sont intégrées. Cette approche multisource est particulièrement puissante pour des tâches variées, telles que la description d’images, la génération d’illustrations à partir de textes, ou même les systèmes de question-réponse basés sur des contenus visuels.

À cette fusion de données se rajoute l’apprentissage par transfert, une technique où le modèle est pré-entraîne sur un vaste corpus de données. Grâce à cela, le VLM peut capturer des nuances contextuelles et des associations complexes entre texte et imagerie, améliorant ainsi ses performances sur des tâches spécifiques même avec peu de données d’entraînement supplémentaires. La compréhension du contexte est essentielle : par exemple, un VLM pourrait reconnaître qu’une image de fleurs évoque des sentiments de beauté ou de sérénité, tout en étant capable de générer des descriptions textuelles poétiques à ce sujet.

Enfin, pour garantir la robustesse et l’efficacité de ces modèles, des mécanismes d’attention sont souvent utilisés. Ces mécanismes permettent au modèle de se concentrer sur certaines parties de l’entrée, qu’il s’agisse d’un texte spécifique ou d’une zone particulière d’une image. Grâce à cette finesse d’attention, les VLMs peuvent générer des résultats plus précis et plus nuancés. Plonger dans les détails de ces mécanismes donne une perspective enrichissante sur la manière dont les VLMs transforment les interactions entre l’IA et les utilisateurs au sein d’un monde fondamentalement multimédia. Cela ouvre des voies vers des applications futuristes fascinantes dans des domaines allant de l’éducation à la médecine, illustrant l’énorme potentiel de ces modèles. Pour approfondir ces thématiques et découvrir des cas d’utilisation, veuillez consulter cette ressource : ChatPaper.

Applications concrètes des VLMs

Les modèles de langage visuel (VLMs) sont en train de transformer de nombreux secteurs grâce à leurs capacités à traiter et à comprendre les données visuelles et textuelles de manière intégrée. Leur utilisation est désormais courante dans divers domaines, engendrant des applications innovantes qui touchent à la publicité, l’éducation et même l’art. Chacun de ces domaines a ses propres succès notables ainsi que certains échecs qui méritent d’être examinés.

- Publicité : Les VLMs sont devenus des outils précieux pour les spécialistes du marketing. Ils permettent de créer des campagnes publicitaires ciblées qui s’appuient sur des analyses avancées de données démographiques et de comportements utilisateur. Par exemple, certaines entreprises utilisent des VLMs pour générer des visuels adaptés aux préférences de leurs clients, augmentant ainsi l’engagement et, par conséquent, les taux de conversion. Néanmoins, les limites de ces modèles sont également apparentes, notamment lorsque l’interprétation des données visuelles par les VLMs est inadéquate, ce qui peut entraîner des campagnes mal dirigées. Une étude récente sur les performances des VLMs en publicité peut être consultée à l’adresse ici.

- Éducation : Dans le secteur éducatif, les VLMs sont utilisés pour personnaliser l’apprentissage en adéquation avec les besoins individuels des étudiants. Des plateformes éducatives exploitent ces modèles pour fournir des ressources pédagogiques adaptées, créant des environnements d’apprentissage interactifs et engageants. Cependant, des défis persistent, notamment la nécessité d’une supervision humaine pour assurer la pertinence et l’exactitude du contenu généré. Des échecs dans l’utilisation des VLMs dans l’éducation ont été observés lorsque les générateurs de contenu n’ont pas pris en compte les différents styles d’apprentissage, conduisant ainsi à une expérience inégale pour les étudiants.

- Art : Les artistes commencent également à explorer les VLMs comme outils de création. Ces modèles peuvent générer des œuvres d’art à partir de descriptions textuelles, ce qui permet aux artistes de repousser les limites de leur créativité. Cependant, l’une des principales critiques réside dans la question de l’authenticité et de l’originalité des œuvres produites par des machines. Des œuvres générées par des VLMs ont été exposées dans des galeries d’art, suscitant des débats sur la place de l’art généré par l’IA dans le monde créatif traditionnel.

Malgré les défis rencontrés dans ces domaines, les réussites des VLMs ne peuvent être ignorées. De la création de contenu personnalisé à la génération d’art novateur, ces modèles ouvrent la voie à des méthodes de création et d’interaction jamais envisagées auparavant. Il est essentiel de continuer à surveiller les effets de leur adoption dans divers secteurs tout en développant des stratégies pour surmonter les obstacles. Alors que nous avançons, une compréhension approfondie des performances des VLMs dans ces applications concrètes nous éclairera sur leurs potentiels futurs et leurs limites.

Défis et limites des VLMs

Les modèles de langage visuel (VLMs) ont le potentiel de transformer radicalement notre interaction avec les technologies, mais leur déploiement n’est pas sans défis. L’un des plus grands défis liés à l’utilisation des VLMs est la question des biais. En raison de leurs conceptions et des ensembles de données sur lesquels ils sont formés, ces modèles peuvent reproduire ou même amplifier des biais existants dans la société. Par exemple, un VLM pourrait associer certains stéréotypes basés sur l’origine ethnique ou le genre à des images, compromettant ainsi leur intégrité et leur fiabilité. Ces biais peuvent non seulement influencer la façon dont les résultats sont interprétés mais également créer des problèmes éthiques liés à l’équité et à la justice sociale.

De plus, un autre défi est lié à la transparence des algorithmes. La plupart des VLMs fonctionnent comme des « boîtes noires », rendant difficile la compréhension des décisions qu’ils prennent. Cela soulève des préoccupations, notamment en matière de responsabilité. Qui est à blâmer si un modèle produit une analyse fausse ou biaisée ? Ce manque de transparence complique les efforts visant à rectifier les erreurs et à corriger les biais, rendant ainsi indispensable la mise en place de mécanismes d’audit et de contrôle pour s’assurer que ces modèles fonctionnent de manière éthique et responsable.

En outre, les limites technologiques des VLMs posent également problème. Actuellement, ces modèles nécessitent de grandes quantités de données pour fonctionner efficacement, ce qui soulève des préoccupations relatives à la protection de la vie privée. La collecte et le traitement de données sensibles peuvent conduire à des violations de la vie privée, affectant ainsi la confiance des utilisateurs. D’autre part, les algorithmes peuvent avoir des difficultés à généraliser les connaissances acquises sur de nouveaux types de données, limitant leur efficacité dans des scénarios inconnus ou inédits.

Le développement de VLMs devrait également faire face à des problématiques concernant l’interprétabilité des résultats. Les utilisateurs veulent comprendre comment un modèle est parvenu à une certaine conclusion, surtout lorsqu’il s’agit de décisions sensibles telles que les soins de santé ou les choix juridiques. Cela exigera des avancées technologiques pour améliorer la capacité des VLMs à fournir des justifications claires et transparentes sur leurs conclusions.

Enfin, il est crucial de prendre en compte les implications sociétales de l’adoption généralisée des VLMs. Les entreprises et les institutions doivent faire preuve d’une prudence accrue dans leur mise en œuvre, afin d’éviter des résultats inattendus ou des dommages collatéraux. En somme, bien que les VLMs offrent d’importantes opportunités pour l’innovation et l’efficacité, il est essentiel de naviguer habilement à travers ces défis pour en réaliser le plein potentiel tout en respectant l’éthique et les droits des individus. Pour des perspectives plus approfondies sur ces enjeux, vous pouvez consulter ce lien.

L’avenir des modèles de langage visuel

À mesure que la technologie des modèles de langage visuel (VLM) continue d’évoluer, le futur de cette discipline promet des avancées significatives qui pourraient profondément changer notre manière d’interagir avec le monde numérique. Les VLMs combinent l’apprentissage des langues avec la perception visuelle, et leur potentiel semble exponentiel. Nous pouvons nous attendre à des applications beaucoup plus intégrées et sophistiquées dans de nombreux domaines.

Parmi les principales tendances d’évolution attendues, l’amélioration de la compréhension contextuelle mérite d’être soulignée. Actuellement, les VLMs sont déjà capables d’interpréter des images et des textes grâce à des méthodes de traitement avancées. Cependant, l’avenir pourrait voir ces modèles atteindre un niveau de compréhension quasi humain, où ils pourraient non seulement reconnaître les objets dans une image, mais aussi percevoir les interactions, les émotions, et les contextes complexes qui y sont associés. Cela pourrait transformer des expériences telles que la réalité augmentée, où le monde physique et numérique se croisent de manière transparente.

De plus, l’intégration des VLMs dans les systèmes d’assistance virtuelle est prometteuse. Imaginez des plateformes qui pourraient anticiper vos besoins en analysant non seulement ce que vous dites, mais aussi ce qui se passe visuellement autour de vous. Cette capacité à fusionner langage, vision et contexte pourrait révolutionner non seulement notre interactif avec les appareils, mais aussi la façon dont nous expérimentons le contenu numérique. Par exemple, une recherche visuelle dans une galerie d’art pourrait être enrichie par des descriptions audios supplémentaires générées en temps réel par un VLM, en fonction des réponses des visiteurs.

À investir dans l’éducation et la formation, les VLMs pourraient transformer la manière dont nous enseignons et apprenons. Imaginez des outils d’apprentissage qui adaptent le contenu en fonction des réactions visuelles et langagières des étudiants, rendant l’apprentissage plus interactif basé sur les stimuli visuels. Cela pourrait également avoir des implications importantes dans des contextes de besoin spécifique, tels que l’éducation pour les personnes malvoyantes, où les descriptions verbales d’images pourraient être perfectionnées par des modèles toujours plus intelligents.

Toutefois, avec ces avancées viennent des défis. La question de l’éthique et de la sécurité des données est cruciale : comment assurer que les VLMs respectent la vie privée des utilisateurs, tout en étant capables de fournir des interactions personnalisées et pertinentes ? De plus, le potentiel d’utilisation des VLMs pour des applications manipulatrices ou malveillantes nécessite une régulation et une réflexion sérieuses au sein de la communauté scientifique et technologique. En fin de compte, pour en savoir plus sur ces questions et leur impact possible sur nos interactions quotidiennes, cette étude approfondie des VLMs ouvre une porte vers l’avenir fascinant qui nous attend.

Conclusion

En somme, les modèles de langage visuel aggregent des technologies avancées et des applications pratiques qui redéfinissent notre interaction avec le monde numérique. Leurs capacités à jongler entre texte et image ouvrent des avenues infinies dans des secteurs variés, allant de la santé à l’éducation. Toutefois, il est crucial de rester vigilant face aux défis que ces systèmes posent, notamment en matière de biais algorithmiques et de dégagement de responsabilité. Certains craignent que ces technologies exacerbent les problèmes de désinformation ou de manipulation de contenu. D’autres voient en elles l’avenir de la créativité humaine. La vérité risque d’être entre les deux. En tant qu’utilisateurs et citoyens du monde technologique, il est essentiel de questionner, critiquer et comprendre ces outils qui façonnent notre réalité. Les VLMs représentent une arme à double tranchant ; leur impact dépendra d’une utilisation éthique et réfléchie. Alors, prêts à embrasser ou à redouter cette innovation ?

FAQ

Qu’est-ce qu’un modèle de langage visuel ?

Un modèle de langage visuel (VLM) est un système d’intelligence artificielle capable d’analyser à la fois du texte et des images pour générer des réponses ou des descriptions.

Comment fonctionnent-ils ?

Les VLMs utilisent des réseaux de neurones pour traiter et comprendre le langage et les visuels, souvent en recourant à des architectures comme les transformers.

Quels domaines sont affectés par les VLMs ?

Les VLMs sont utilisés dans divers secteurs tels que le marketing, l’éducation, la santé et même l’art.

Sont-ils idéaux pour l’application d’IA ?

Bien qu’ils possèdent de nombreuses capacités, les VLMs présentent aussi des défis, notamment en ce qui concerne les biais et les erreurs d’interprétation.

À quoi s’attendre pour l’avenir ?

Les progrès en matière de VLMs pourraient entraîner des changements radicaux dans la manière dont nous consommons et interagissons avec les informations, rendant le contenu numérique plus interactif et engageant.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

- Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.