Qu’est-ce qui se cache derrière le paysage dynamique des LLMs multimodaux qui émergent en 2025 ? Ces systèmes d’intelligence artificielle allient texte, audio et image pour créer des expériences d’interaction uniques et enrichissantes. Alors que ces modèles révolutionnent notre rapport à la technologie, il est essentiel de les déchiffrer et d’analyser à quoi ils pourraient réellement servir. Préparez-vous à plonger dans un futur où l’IA devient vraiment humaine.

L’évolution des LLMs

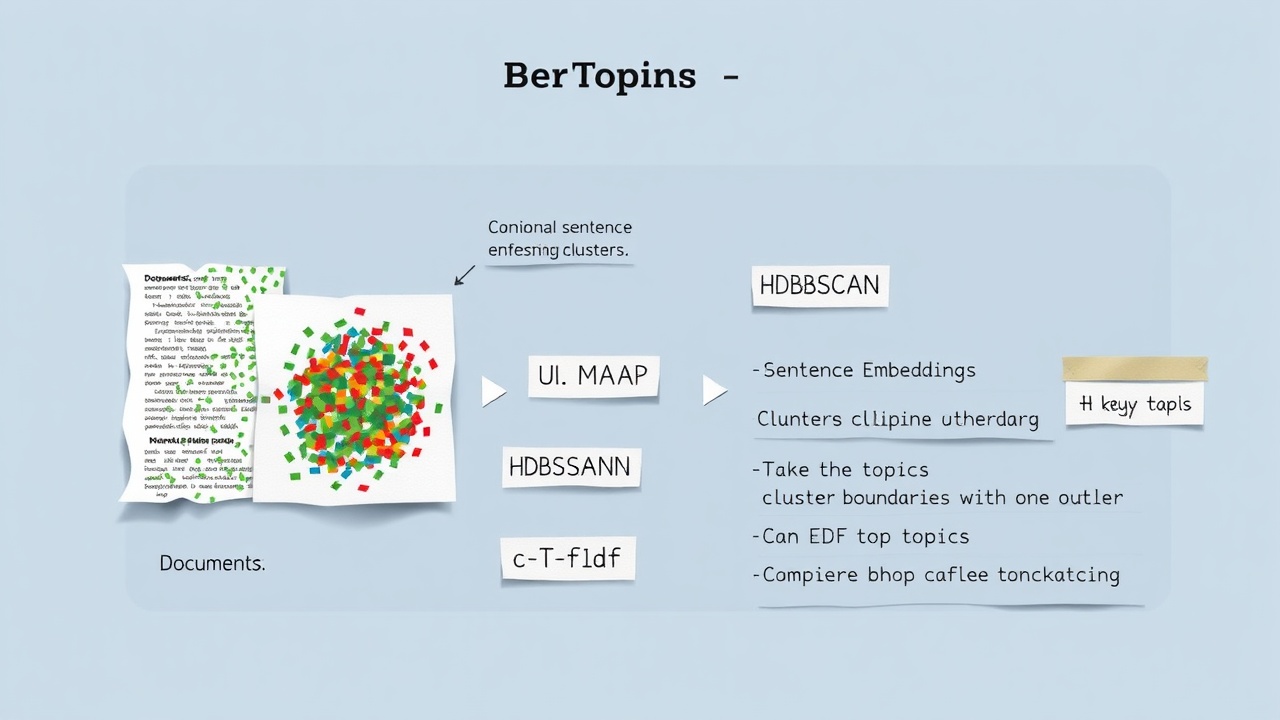

Au cours de la dernière décennie, les modèles de langage ont connu une évolution rapide et remarquable qui les a propulsés vers des capacités multimodales. Initialement, les modèles de langage tels que GPT-2 ou BERT étaient principalement axés sur le traitement du texte et l’analyse linguistique. Leur objectif principal était de générer du texte cohérent en se basant sur les séquences de mots, sans réel contact avec d’autres formes de données telles que les images ou les sons.

La transition vers des modèles multimodaux a débuté avec des architectures capables de fusionner les informations provenant de diverses sources. Cela a permis d’accroître l’interaction et les performances des IA dans des tâches complexes nécessitant une compréhension approfondie de contextes variés. Par exemple, l’intégration de données visuelles dans le traitement du langage a ouvert la voie à des applications innovantes telles que la description d’images, les systèmes de recommandation basés sur des contenus visuels et textuels, et même la génération de réponses interactives dans des environnements virtuels.

Les modèles multimodaux d’aujourd’hui, comme ceux basés sur l’architecture CLIP, sont conçus pour traiter simultanément le texte et les images. Cette capacité d’intégrer et d’analyser différentes modalités renforce non seulement la flexibilité des modèles, mais permet aussi aux systèmes d’IA de développer une compréhension plus riche et contextualisée des données. En permettant aux utilisateurs d’interagir avec l’IA d’une manière dynamique, ces modèles améliorent considérablement l’expérience utilisateur.

Leurs applications couvrent divers domaines, allant des assistants virtuels intelligents aux systèmes de vision par ordinateur, permettant ainsi une synergie entre l’analyse textuelle et visuelle. Par ailleurs, ces évolutions se poursuivent, encourageant la recherche pour explorer des modalités encore plus variées, comme le son ou les capteurs environnementaux, augmentant le potentiel d’interaction humaine.

Pour en savoir plus sur l’état actuel et les tendances futures des modèles d’IA multimodaux, vous pouvez consulter cet article fascinant ici.

Applications pratiques des LLMs multimodaux

Les LLMs multimodaux, de par leur capacité à traiter et générer du texte, de l’image, et d’autres types de données, ouvrent la voie à des applications révolutionnaires dans divers secteurs. Leur impact est particulièrement notable dans des domaines tels que l’éducation, la santé et le divertissement.

- Éducation : Dans le secteur éducatif, les LLMs multimodaux sont utilisés pour créer des expériences d’apprentissage personnalisées. Par exemple, des entreprises comme Duolingo intègrent des chatbots IA qui s’adaptent aux préférences et aux styles d’apprentissage des utilisateurs, leur fournissant du contenu visuel et des exercices interactifs. Ces systèmes aident non seulement à teach mais aussi à engager les apprenants de manière plus efficace en leur offrant des retours en temps réel sur leur performance.

- Santé : Dans le domaine de la santé, les LLMs multimodaux sont en train de transformer la manière dont les professionnels interagissent avec les patients. Des sociétés telles que Babylon Health utilisent ces modèles pour fournir des consultations médicales virtuelles, combinant des analyses de texte et d’image pour évaluer les symptômes. De plus, des applications sont développées pour aider à la médecine préventive en analysant des données multimodales, comme les historiques médicaux et les résultats de tests, afin de proposer des traitements personnalisés. Vous trouverez plus d’informations sur ces innovations dans cet article ici.

- Divertissement : Le secteur du divertissement connaît également une révolution grâce aux LLMs multimodaux. Des plateformes comme Netflix et Spotify utilisent ces modèles pour analyser les préférences des utilisateurs et recommander du contenu approprié de manière plus robuste. Par exemple, Netflix pourrait analyser les critiques écrites ainsi que les impressions visuelles pour affiner ses algorithmes de recommandation, permettant ainsi une expérience consommateur enrichie et adaptée.

Ces applications concrètes montrent comment les LLMs multimodaux, en intégrant différentes modalités de données, améliorent l’interaction humaine et ouvrent des voies vers des solutions innovantes dans divers secteurs. L’avenir de ces technologies semble prometteur, et leur intégration continue dans notre quotidien facilitera des interactions plus riches et significatives.

Défis et préoccupations éthiques

Les modèles multimodaux de traitement du langage naturel (LLMs) de 2025, bien qu’ils promettent des interactions plus riches et adaptatives, soulèvent également d’importantes préoccupations éthiques. L’une des principales limites des LLMs réside dans les biais inhérents aux données sur lesquelles ils sont formés. Ces biais peuvent se manifester de différentes manières, notamment dans les réponses générées qui peuvent perpétuer des stéréotypes ou des discriminations basées sur la race, le genre ou d’autres caractéristiques. Par exemple, si un modèle est principalement formé sur des contenus créés par une tranche démographique particulière, cela peut entraîner une représentation déséquilibrée des points de vue et des expériences d’autres groupes. Il est essentiel de prendre en compte cette réalité afin d’assurer que les sorties générées par ces systèmes soient justes et équilibrées.

En outre, l’utilisation de LLMs multimodaux pose des questions significatives sur la vie privée des utilisateurs. Ces modèles nécessitent souvent d’énormes quantités de données pour être efficaces, ce qui soulève le problème de la collecte et du stockage de données personnelles sensibles. Les utilisateurs peuvent ne pas être pleinement conscients de la manière dont leurs informations sont utilisées, ni des implications potentielles d’une telle utilisation. Les préoccupations autour de la surveillance et des violations de la vie privée peuvent donc être exacerbées par la puissance de ces outils, qui s’intègrent de plus en plus dans notre quotidien.

Il est également crucial de considérer l’impact que ces modèles multimodaux peuvent avoir sur l’emploi. Leur capacité à automatiser des tâches complexes peut entraîner la suppression de certains emplois, en particulier ceux qui impliquent des interactions répétitives ou basées sur des règles. Cette dynamique soulève la question de la responsabilité sociale des entreprises qui développent et déploient ces technologies. Afin de garantir que l’innovation ne se fasse pas au détriment des travailleurs, une discussion autour de l’éthique et de la responsabilité doit être engagée dès les phases de conception des LLMs.

Pour approfondir cette question de l’éthique dans les LLMs multimodaux et découvrir des approches potentielles pour atténuer ces préoccupations, vous pouvez consulter ce lien.

L’avenir des LLMs multimodaux

En 2025, l’essor des LLMs (Large Language Models) multimodaux sera synonyme d’une transformation radicale des interactions humaines, tant sur le plan personnel que professionnel. Ces modèles d’IA, capables d’analyser et de synthétiser différentes modalités de données telles que le texte, l’image, le son et même le mouvement, offriront des expériences utilisateur riches et personnalisées. L’intégration de ces systèmes transformera la façon dont nous communiquons et collaborons.

Dans le monde professionnel, les LLMs multimodaux redéfiniront les relations entre collègues et avec les clients. Par exemple, des outils comme les assistants virtuels intelligents pourront analyser simultanément des emails, des documents visuels et des enregistrements audio pour fournir des solutions adaptées et des recommandations stratégiques en temps réel. Cela permettra aux équipes de se concentrer sur des tâches à plus forte valeur ajoutée, en se battant moins contre le temps et la diversité des informations à traiter.

Les innovations à venir pourraient inclure des interactions plus immersives grâce à la réalité augmentée et virtuelle. Imaginez des réunions où les participants utilisent des avatars alimentés par des LLMs multimodaux pour interagir dans des environnements simulés, rendant les échanges plus intuitifs et engageants. De même, les expériences d’apprentissage seront révolutionnées, offrant des parcours éducatifs adaptés aux besoins individuels des apprenants, en intégrant textes, vidéos, et simulations interactives.

- Les robots d’accueil dans les entreprises, capables de comprendre à la fois le langage verbal et non-verbal, seront courants.

- Des systèmes d’IA qui pourront mener des entretiens d’embauche, analysant non seulement les réponses des candidats, mais aussi le ton et l’expression faciale.

- Des outils de prise de décision assistée qui analyseront des données multimodales pour offrir des insights précis basés sur des scénarios complexes.

Ces avancées entraîneront également des défis en matière d’éthique et de vie privée. Un équilibre devra être trouvé entre l’exploitation des données pour optimiser les interactions et la protection des droits des individus. Ainsi, bien que les LLMs multimodaux aient le potentiel d’améliorer considérablement nos vies et notre travail, ils soulèveront des questions cruciales sur la confiance et la sécurité qui nécessiteront des discussions approfondies dans les années à venir.

Conclusion

En explorant ces LLMs multimodaux, il devient clair qu’ils transformeront la manière dont nous interagissons avec la technologie dans un avenir proche. En facilitant des échanges à la fois complexes et intuitifs, ces modèles nous rapprochent d’une AI vraiment intégrée dans notre quotidien. Toutefois, il est impératif de rester vigilant quant à leurs limitations et implications éthiques. Saurons-nous les utiliser à bon escient ?

FAQ

Quels sont les LLMs multimodaux ?

Les LLMs multimodaux combinent plusieurs types de données, par exemple, texte, images et son, pour permettre des interactions riches et variées.

Ces modèles vont au-delà de la simple compréhension textuelle et d’autres formats, créant une expérience utilisateur plus dynamique.

Comment ces modèles améliorent-ils l’expérience utilisateur ?

Ils facilitent une communication plus naturelle, faisant ressortir des réponses adaptées au contexte, qu’importent les formes de données utilisées.

Par exemple, un LLM multimodal peut décrire une image tout en répondant à des questions textuelles, rendant les interactions très fluides.

Quels sont les enjeux de l’utilisation de ces LLMs ?

Les enjeux incluent des préoccupations éthiques et de biais, nécessitant une gouvernance attentive pour éviter des dérives potentielles.

Il est crucial de veiller à ce que les algorithmes ne renforcent pas des stéréotypes ou ne perdent pas en objectivité.

Où voir ces technologies intégrées en 2025 ?

On peut s’attendre à les voir dans des domaines variés comme l’apprentissage en ligne, l’assistance médicale et les jeux vidéo.

Chaque domaine offre des pistes fascinantes pour exploiter le potentiel des LLMs multimodaux au service de l’expérience utilisateur.

Comment peut-on se préparer à ces changements ?

Restez informé des tendances technologiques et participez à des discussions sur l’éthique de l’IA pour mieux comprendre les implications de ces innovations.

Se former sur l’utilisation des LLMs et leur impact est aussi essentiel pour toute carrière future dans le domaine technologique.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

- Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.