L’intelligence artificielle transforme notre manière d’analyser et d’interpréter les données, mais quelles tendances émergent réellement dans ce domaine en constante évolution ? Les modèles de langage (LLM) et les systèmes de génération de réponses augmentées (RAG) offrent des perspectives inédites pour l’exploitation des données. Pourtant, derrière cette vitrine technologique se cachent de nombreuses implications, tant positives que dérangeantes. Cet article explore les récents développements de l’IA en matière d’analyse de données, des outils open source comme ContextCheck aux défis éthiques et pratiques qu’ils soulèvent. C’est l’occasion de s’interroger sur ce que signifie naviguer dans le monde numérique d’aujourd’hui, où l’IA peut à la fois éclairer notre compréhension et compliquer notre rapport à l’information.

L’essor des modèles de langage

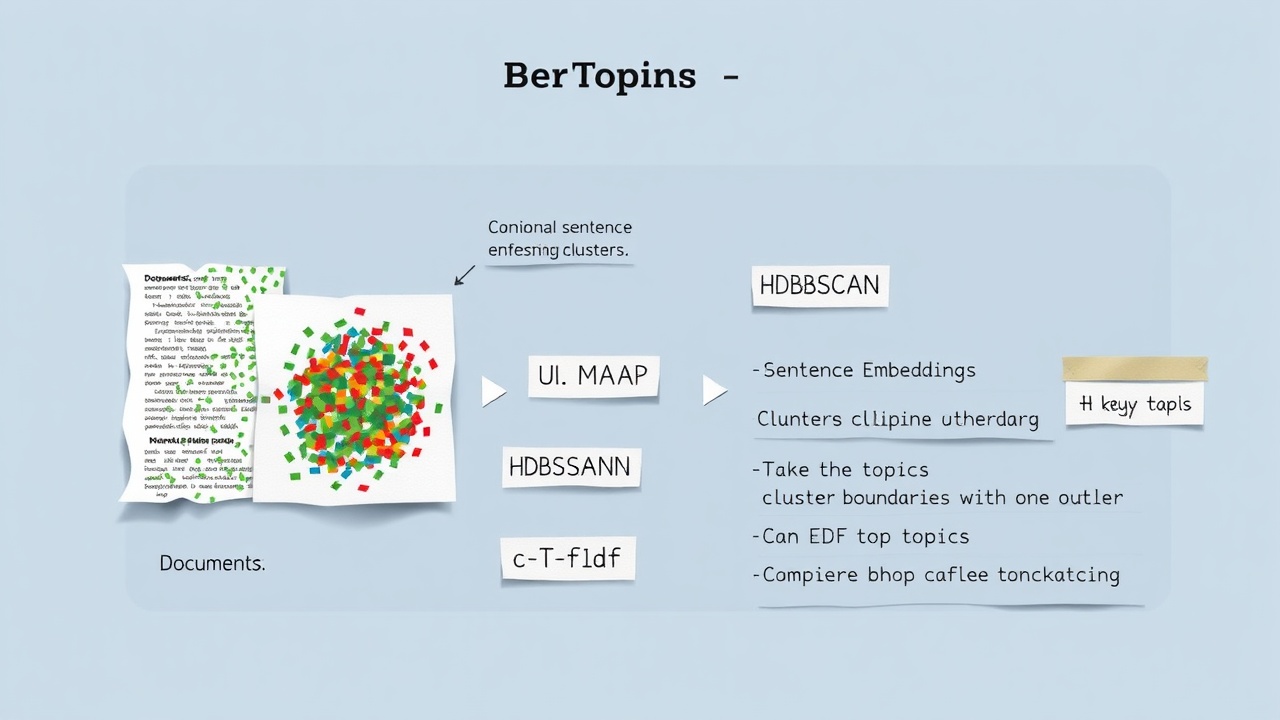

L’essor des modèles de langage a profondément transformé le paysage de l’analyse des données. Ces modèles, tels que GPT et BERT, ont été conçus pour traiter et comprendre de vastes volumes d’informations textuelles, ce qui les rend particulièrement adaptés aux besoins des analystes de données. En raison de leur capacité à extraire des informations contextuelles et à offrir des réponses adaptées, ils constituent un atout précieux dans la prise de décisions basées sur des données.

L’une des caractéristiques les plus remarquables des modèles de langage est leur capacité à gérer des flux de données massifs. Grâce à l’apprentissage profond et aux architectures neuralement avancées, ces modèles peuvent analyser des ensembles de données textuelles provenant de multiples sources—y compris les réseaux sociaux, les forums en ligne, et les rapports d’entreprise. Cela permet aux professionnels de l’analyse de s’appuyer sur des insights générés par l’IA pour mieux comprendre les tendances et les comportements des consommateurs.

Un autre aspect qui mérite d’être souligné est la nature prédictive de ces modèles. Lorsqu’ils sont alimentés avec des données passées, les modèles de langage peuvent non seulement identifier des schémas, mais aussi prévoir des résultats futurs avec un degré de précision étonnant. Par exemple, en exploitant des données historiques sur les ventes et le comportement des clients, les analystes peuvent tirer parti des modèles de langage pour anticiper la demande de certains produits, ajuster les stratégies marketing, et optimiser les chaînes d’approvisionnement.

En outre, la capacité des modèles de langage à comprendre le contexte et les nuances de la langue humaine les rend particulièrement efficaces pour traiter des requêtes complexes. Traditionnellement, l’analyse des données nécessitait des requêtes spécifiques, souvent formulées dans un langage technique. Aujourd’hui, grâce à ces avancées, les utilisateurs peuvent poser des questions en langage naturel, permettant une interaction plus intuitive avec les systèmes d’information. Cela élargit les possibilités d’accès à l’information à un public plus large, y compris ceux qui n’ont pas de formation technique.

La combinaison de ces capacités ouvre la voie à une meilleure visualisation des données. Les modèles de langage peuvent rédiger des résumés, générer des descriptions et même créer des rapports contextuels basés sur les données disponibles. Cela permet aux utilisateurs d’obtenir rapidement des insights critiques sans avoir à plonger dans les détails bruts des données.

En somme, l’essor des modèles de langage a redéfini les méthodes d’analyse des données, offrant une approche plus adaptable, contextuelle et prédictive. Leur capacité à traiter de grandes quantités d’informations et à fournir des réponses pertinentes ne fait que renforcer leur importance croissante dans le domaine de l’intelligence artificielle. Pour découvrir plus sur l’évolution de ces technologies, consultez ce lien : Tendances de l’intelligence artificielle.

Les systèmes de génération de réponses augmentées

Les systèmes de génération de réponses augmentées (RAG) jouent un rôle fondamental dans l’optimisation de la prise de décision fondée sur l’analyse des données. Ces systèmes combinent l’extraction d’informations issues de diverses bases de données avec des modèles de langage avancés (LLM) pour produire des réponses pertinentes et contextualisées aux requêtes des utilisateurs. En améliorant l’accès aux informations et en facilitant une compréhension plus nuancée des données, les RAG transforment la façon dont les entreprises et les chercheurs prennent des décisions stratégiques.

Le mécanisme principal des RAG repose sur leur capacité à récupérer rapidement des données précises, qui sont ensuite enrichies par l’interprétation des LLM. Cette synergie entre la récupération et la génération des informations permet de répondre à des questions complexes et d’analyser des scénarios variés tout en réduisant l’ambiguïté. Par exemple, lorsqu’un analyste pose une question précise, le RAG identifie les documents les plus pertinents dans les vastes volumes de données disponibles, avant de les compiler de manière intelligible grâce à un LLM.

Une application courante des systèmes RAG se trouve dans le domaine de la recherche commerciale. Les entreprises doivent souvent jongler avec des données disparates pour prendre des décisions éclairées. Grâce aux RAG, ces organisations peuvent non seulement accéder à des données historiques, mais également interpréter des tendances émergentes en temps réel. Cette capacité à intégrer des données hétérogènes permet aux entreprises de réagir plus rapidement aux fluctuations du marché et d’anticiper les besoins futurs des consommateurs.

De plus, les RAG font une différence notoire dans le secteur de l’assistance client, où des réponses instantanées et précises peuvent améliorer l’expérience utilisateur. Lorsqu’un client pose une question sur un produit, par exemple, un RAG peut analyser les requêtes précédentes, les avis des utilisateurs et les documents techniques pour offrir une réponse concise et informative. Cela dépasse le simple traitement des requêtes pour établir une interaction plus naturelle et satisfaisante.

Les systèmes de génération de réponses augmentées transforment également la formation et le développement personnel dans les entreprises. En permettant un accès rapide à des tutoriels, des études de cas et des mises à jour sur les meilleures pratiques, ces systèmes favorisent un environnement d’apprentissage continu. En conséquence, les collaborateurs restent informés des dernières tendances et compétences du marché.

Cependant, il est essentiel de reconnaître que l’implémentation des RAG n’est pas sans défis. La qualité des réponses dépend directement de la qualité des données récupérées. Pour garantir l’efficacité des décisions prises grâce à ces systèmes, il est indispensable de s’assurer que les données sont fiables et mises à jour. L’optimisation continue des algorithmes de récupération et de génération est donc cruciale.

Pour en savoir plus sur la façon dont les RAG peuvent transformer le processus décisionnel, consultez cet article, qui explore des exemples concrets d’applications des systèmes RAG dans divers domaines. En amalgamant la puissance de l’analyse de données avec des stratégies de réponse efficaces, les RAG sont voués à jouer un rôle de plus en plus crucial dans le paysage de l’intelligence artificielle et de la prise de décision.

Défis éthiques et biais des algorithmes

L’utilisation de l’intelligence artificielle dans l’analyse des données, bien que révolutionnaire, soulève des préoccupations éthiques cruciales. En effet, les algorithmes, souvent perçus comme des outils neutres, peuvent en réalité refléter les biais humains présents dans les données sur lesquelles ils s’appuient. Ces biais peuvent non seulement réduire l’efficacité des analyses, mais également engendrer des conséquences néfastes, notamment en matière de discrimination dans des domaines tels que le recrutement, le crédit ou même l’application de la loi.

Les défis éthiques liés à l’IA se manifestent de plusieurs manières. D’une part, la question de la transparence des algorithmes est primordiale. Les utilisateurs doivent comprendre comment les décisions sont prises et sur quels critères elles reposent. Cependant, de nombreux algorithmes de machine learning, en particulier ceux basés sur des modèles complexes tels que les réseaux de neurones, agissent comme des « boîtes noires ». Cela rend difficile la détection de biais ou d’irrégularités dans leur fonctionnement, ce qui peut mener à des décisions injustes ou non fondées.

D’autre part, la gestion des données personnelles est une préoccupation croissante. Avec la collecte massive de données, les entreprises doivent garantir que les utilisateurs sont pleinement informés de la manière dont leurs données sont utilisées et protégées. La question de la vie privée vient se superposer à celle de l’intégrité des données : il est essentiel que les informations sensibles ne soient pas utilisées à des fins nuisibles. Des réglementations telles que le Règlement général sur la protection des données (RGPD) en Europe et d’autres initiatives à travers le monde tentent de répondre à ces défis, mais leur mise en œuvre reste complexe.

Les indices de biais dans les résultats d’IA peuvent également être invisibles. Par exemple, une étude récente a montré que des systèmes de reconnaissance faciale peuvent avoir des taux d’erreur significativement plus élevés pour certain(e)s groupes raciaux en raison d’un manque de diversité dans les ensembles de données d’entraînement. Cela met en lumière l’importance d’une approche éthique dans la conception d’algorithmes, où la diversité et l’inclusivité doivent être prises en compte dès le départ pour éviter de renforcer les stéréotypes existants.

Il faut également s’interroger sur les responsabilités des entreprises qui développent ces technologies. Elles ont un rôle central à jouer dans la lutte contre les biais algorithmiques. De plus en plus, les organisations adoptent des lignes directrices et des pratiques éthiques dans le développement de l’IA, mais la vigilance est de mise pour s’assurer que ces mesures ne sont pas seulement superficielles. Une approche proactive, impliquant une évaluation régulière des impacts éthiques des algorithmes, est nécessaire pour s’assurer que l’IA sert réellement le bien commun.

Pour approfondir ces enjeux, il est essentiel de se pencher sur des ressources pertinentes et des études de cas. Pour en savoir plus sur la lutte contre les biais algorithmiques et les défis des IA génératives, vous pouvez consulter cet article : voir l’article. Dans cet article, vous découvrirez comment les entreprises peuvent mettre en place des stratégies efficaces pour minimiser les biais et promouvoir l’éthique dans leurs pratiques d’analyse des données.

Le cadre open source ContextCheck

ContextCheck est un outil open source innovant qui joue un rôle essentiel dans le test et l’évaluation des modèles de langage (LLM) et des systèmes de génération d’IA (RAG). Dans un domaine où la transparence et l’accessibilité sont de plus en plus demandées, ContextCheck se révèle comme un projet crucial pour les chercheurs et les praticiens de l’IA désireux de comprendre pleinement le fonctionnement interne de ces technologies avancées.

L’un des principaux atouts de ContextCheck réside dans sa capacité à fournir une interface simple et intuitive pour tester les LLM et les RAG dans divers contextes d’utilisation. En utilisant cet outil, les utilisateurs peuvent facilement configurer des scénarios spécifiques afin d’analyser comment les modèles répondent à différentes entrées et contextes. Cette fonctionnalité permet aux développeurs et aux chercheurs d’identifier les biais, les lacunes et les imperfections de ces modèles, favorisant ainsi un environnement de développement plus responsable. De plus, en tant qu’outil open source, ContextCheck garantit que toute la communauté peut participer à son développement et à sa mise à jour, ce qui améliore continuellement sa robustesse et son efficacité dans l’évaluation des performances des modèles.

Un autre aspect important de ContextCheck est sa contribution à la transparence des modèles d’IA. Dans un monde où les préoccupations concernant la responsabilité algorithmique grandissent, l’accès à des outils tels que ContextCheck permet aux utilisateurs de mieux comprendre les décisions prises par les LLM et les RAG. Les résultats des tests effectués avec cet outil peuvent être partagés et analysés collectivement, renforçant ainsi une approche collaborative dans l’évaluation des pratiques d’IA. Cela devient particulièrement pertinent dans des domaines sensibles où les décisions automatisées peuvent avoir un impact significatif sur les vies humaines.

Dernièrement, les entreprises et les institutions commencent à intégrer ContextCheck dans leurs pipelines de développement afin de s’assurer que les modèles IA qu’elles déploient respectent des normes éthiques et de qualité. En s’appuyant sur la communauté open source, les organisations ont la possibilité de contribuer à des efforts plus vastes pour standardiser les pratiques d’évaluation des IA, ce qui, à long terme, peut favoriser une adoption plus large et plus sûre de ces technologies.

En somme, ContextCheck représente une avancée significative vers la démocratisation de l’intelligence artificielle pour l’analyse des données. En permettant aux utilisateurs de tester et d’analyser les LLM et les RAG de manière accessible, ce cadre ouvre la voie à un avenir d’IA plus transparent et plus responsable. Pour explorer davantage comment l’analyse des données et l’intelligence artificielle interagissent, vous pouvez consulter cette ressource [ici](https://www.opentext.com/fr-fr/data-analytics-and-ai-trends?utm_source=vizyz.com&utm_campaign=article-webanalyste.com&utm_medium=referral). Cela pourrait enrichir votre compréhension des dernières tendances et pratiques dans ce domaine en pleine évolution.

Vers une intelligence artificielle responsable

Dans le monde en constante évolution de l’intelligence artificielle, la responsabilité sociale est devenue un enjeu central. Alors que l’analyse des données s’accélère grâce à des outils d’IA de plus en plus performants, il est crucial de garder à l’esprit les implications éthiques de ces avancées. Cela implique une réflexion sur la manière dont les algorithmes sont conçus, entraînés et appliqués, afin de mitiger les risques potentiels associés à leur utilisation.

La première étape vers une intelligence artificielle responsable consiste à adopter une transparence radicale. Les entreprises doivent non seulement clarifier le fonctionnement de leurs modèles, mais aussi fournir des explications compréhensibles sur les décisions prises par ceux-ci. Cela implique de rendre accessibles aux utilisateurs et aux parties prenantes les données d’entraînement, les méthodes de validation ainsi que les résultats des analyses. Une telle approche favorisera la confiance entre les développeurs d’IA et les utilisateurs finaux, tout en permettant de remonter à la source des biais qui pourraient se glisser dans les systèmes.

Un autre aspect essentiel de la responsabilité en matière d’IA réside dans la gouvernance des données. L’utilisation de jeux de données diversifiés et représentatifs est cruciale pour minimiser les biais dans les modèles prédictifs. Cela nécessite une collaboration entre les experts en données, les éthiciens et les groupes de défense des droits, afin de garantir que la collecte et l’utilisation des données respectent des normes éthiques élevées. Dans ce contexte, il est important que les entreprises se dotent de comités éthiques capables d’évaluer l’impact sociétal de leurs projets d’IA.

Par ailleurs, l’intelligence artificielle doit être orientée vers le bien commun. Au lieu de se limiter à maximiser le profit, les entreprises doivent intégrer des objectifs sociaux dans leur stratégie. Que ce soit en améliorant l’accès à des services essentiels ou en proposant des solutions innovantes aux problèmes sociétaux, l’IA peut jouer un rôle majeur. Par exemple, des analyses de données basées sur l’IA peuvent contribuer à la lutte contre les inégalités en identifiant les zones géographiques ou les populations défavorisées qui nécessitent une attention particulière.

Enfin, la formation et la sensibilisation des utilisateurs sont des piliers fondamentaux pour une intelligence artificielle responsable. Cela comprend non seulement les ingénieurs et les développeurs d’IA, mais également les utilisateurs finaux qui doivent être éduqués sur les capacités et les limites des systèmes d’IA. Une meilleure compréhension de l’IA et de son fonctionnement peut réduire la méfiance et encourager une utilisation plus réfléchie et éthique des outils d’analyse de données.

Pour en savoir plus sur les tendances à venir en matière d’intelligence artificielle et leur impact sur l’analyse de données, vous pouvez consulter cet article ici. En intégrant ces éléments dans la discussion sur l’avenir de l’IA, nous pouvons travailler vers une utilisation plus éthique et inclusive de cette technologie révolutionnaire.

Conclusion

En somme, les dernières tendances en matière d’intelligence artificielle pour l’analyse des données révèlent un paysage à la fois prometteur et complexe. Les LLM comme les RAG ouvrent la voie à de nouvelles méthodes d’exploration des données, permettant des analyses plus profondes et plus nuancées. Cependant, cette avancée n’est pas sans son lot de défis. La transparence des algorithmes, la lutte contre les biais et la nécessité de respecter la vie privée des utilisateurs sont autant d’enjeux cruciaux à prendre en compte. ContextCheck, en tant qu’outil open source, représente un pas vers la démocratisation de ces technologies, mais il remet aussi en question notre rapport à la technologie et à la manière dont nous interprétons les données. L’avenir de l’IA dans l’analyse des données ne dépend pas seulement des prouesses techniques, mais aussi de nos choix éthiques et de nos stratégies opérationnelles. En naviguant dans ces eaux parfois troubles, il est impératif de garder un esprit critique tout en embrassant les innovations. Brisons les barrières, questionnons nos outils, et restons vigilant sur les impacts que l’IA peut avoir sur notre société.

FAQ

Quels sont les modèles de langage (LLM) ?

Les modèles de langage sont des systèmes d’IA conçus pour comprendre et générer du texte. Ils sont utilisés dans de nombreuses applications, allant des chatbots jusqu’à l’analyse sémantique des données.

Qu’est-ce que le système RAG ?

Le système de génération de réponses augmentées (RAG) améliore la capacité d’un modèle à fournir des informations précises en combinant des techniques de génération de langage naturel avec des bases de données externes.

Comment ContextCheck aide-t-il à l’évaluation des modèles d’IA ?

ContextCheck est un cadre open source qui permet de tester la performance et la fiabilité des modèles de langage et des systèmes RAG, assurant ainsi une meilleure transparence dans leur utilisation.

Quels sont les principaux défis éthiques posés par l’IA ?

Les défis comprennent le biais des algorithmes, la vie privée des données et la responsabilité des décisions prises par les systèmes d’IA. Ces enjeux doivent être pris en compte pour développer des applications éthiques.

Quel avenir pour l’IA dans l’analyse des données ?

À l’avenir, l’IA continuera d’évoluer avec des améliorations dans la précision des analyses, mais il est crucial d’adopter une approche responsable pour garantir qu’elle respecte la société et ses valeurs.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

- Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.